从PB到EB 快手HDFS如何实现海量数据存储的层级跨越

在短视频与直播的洪流中,快手每日处理着天文数字般的用户数据。从最初的PB级数据积累,到如今迈向EB(1 EB = 1024 PB)量级的存储需求,快手面临的数据存储挑战是几何级数增长的。其核心存储基石——基于Hadoop分布式文件系统(HDFS)的深度定制化架构,完成了一场从“数据仓库”到“数据海洋”的阶层跨越。这一跨越的实现,并非简单的硬件堆砌,而是一场贯穿架构、运维与服务的系统性革新。

1. 架构革新:从单一集群到联邦与分层

面对EB级数据,传统的单一HDFS集群在元数据管理、扩展性和故障域隔离上很快会遇到瓶颈。快手的解决方案是拥抱HDFS Federation(联邦) 与分层存储架构。

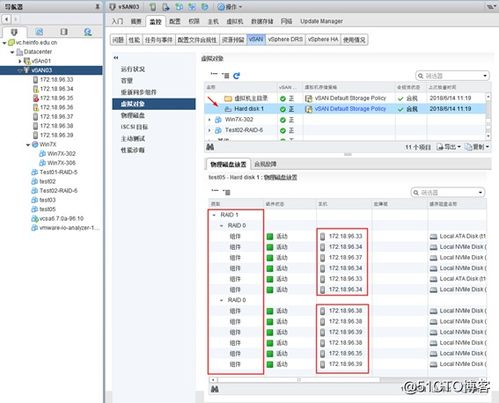

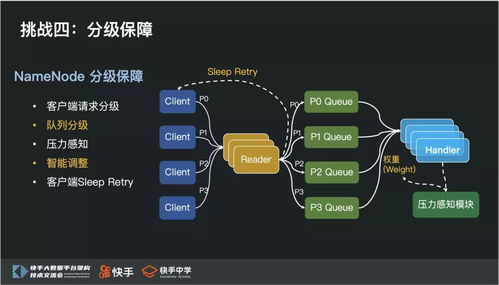

- 联邦化:将单一的NameNode(命名空间管理者)拆分为多个独立的命名空间,每个管理一部分数据。这实现了元数据的水平扩展,避免了单点瓶颈,让集群可以轻松扩展至成千上万个节点。

- 冷热分层:根据数据的访问频率(热数据、温数据、冷数据),将其自动迁移至不同性能/成本的存储介质中。例如,最新的热门视频素材存储在高性能SSD或内存中,而数月前的归档日志则自动下沉至大容量、低成本的机械硬盘或对象存储。这套智能生命周期管理策略,在保证用户体验的将总体存储成本降低了显著比例。

2. 性能与可靠性:深度定制与硬件协同

为了支撑亿级用户同时上传与消费内容,快手对HDFS进行了深度优化。

- EC纠删码的规模化应用:用纠删码(如RS-10+4)替代传统多副本机制(如3副本),在保证数据可靠性的前提下,将存储效率从33%提升至70%以上。这对于海量温冷数据存储而言,节省的硬件成本是EB级别的。

- 软硬件协同优化:与服务器厂商深度合作,定制高密度存储服务器(如“高炮”机型),并优化数据布局策略,减少网络拥堵。在软件层优化读写路径,减少I/O延迟,使NameNode的RPC处理能力提升数倍。

- 高可用与容灾:建立跨地域的多活数据中心。通过持续优化的数据同步与复制机制,确保单个数据中心故障时,服务能无缝切换,数据零丢失。

3. 数据处理与服务化:存储之上的生态构建

存储的终极价值在于被高效使用。快手将HDFS从底层基础设施,升级为统一的数据处理与存储服务平台。

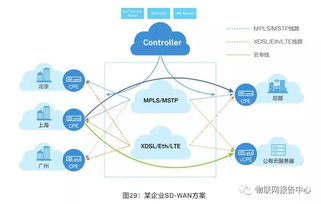

- 统一存储入口:对上层业务(如推荐算法、数据分析、AI训练)提供标准化的HDFS API和对象存储(S3)兼容接口,屏蔽底层复杂的联邦与分层细节,让开发者像使用一个无限容量的“硬盘”一样简单。

- 与计算引擎深度集成:确保HDFS与Spark、Flink、MapReduce等计算框架实现最优配合,数据本地性读取率极高,最大化计算作业效率。支持在存储层进行初步的数据格式转换与压缩(如ORC/Parquet),减少计算时的数据搬运开销。

- 智能化运维与成本洞察:构建覆盖全集群的监控与智能诊断平台,实现故障预测、自动平衡与性能调优。提供清晰的数据存储成本分摊与报表,让每个业务团队都能清晰了解自身的数据“资产”与“消费”。

****

快手HDFS的EB级之路,是一条从“规模驱动”到“效率与智能驱动”的进化之路。它不仅仅是通过增加机器来扩大容量,更是通过架构的分布式解耦、数据的智能生命周期管理、软硬件的协同创新,以及向一体化服务平台演进,实现了存储系统真正的“阶层跨越”。这为所有面临数据爆炸式增长的企业提供了一个可借鉴的范本:在海量数据时代,存储系统的核心竞争力在于其弹性、效率和赋能业务的能力。

如若转载,请注明出处:http://www.52animal.com/product/74.html

更新时间:2026-05-29 09:33:02